Apprendre par l’incertitude

L’intelligence artificielle est souvent présentée comme une machine à produire des réponses. Pourtant, une part essentielle de son fonctionnement repose sur autre chose : la capacité à travailler avec l’incertain, à ajuster des hypothèses et à transformer le doute en mécanisme d’apprentissage.

Apprendre ne signifie pas savoir

L’intelligence artificielle donne souvent l’impression de produire des réponses nettes. Elle classe, prédit, tranche. Pourtant, son fonctionnement réel repose sur une logique plus instable, plus proche du réel : une mécanique d’ajustements continus où l’incertitude n’est pas un défaut, mais une condition de travail.

Dans certains modèles, apprendre ne consiste pas à accumuler des vérités, mais à réviser progressivement une estimation du monde. Cette approche s’inscrit dans la continuité du raisonnement bayésien, qui formalise une manière rigoureuse de transformer une hypothèse à partir de nouvelles observations.

On parle parfois de « croyance initiale ». Le terme doit être compris dans son sens mathématique : il ne renvoie ni à une opinion personnelle, ni à une croyance religieuse, ni à une intuition ésotérique. Il désigne une hypothèse probabiliste, provisoire, chiffrée, construite à partir des informations disponibles.

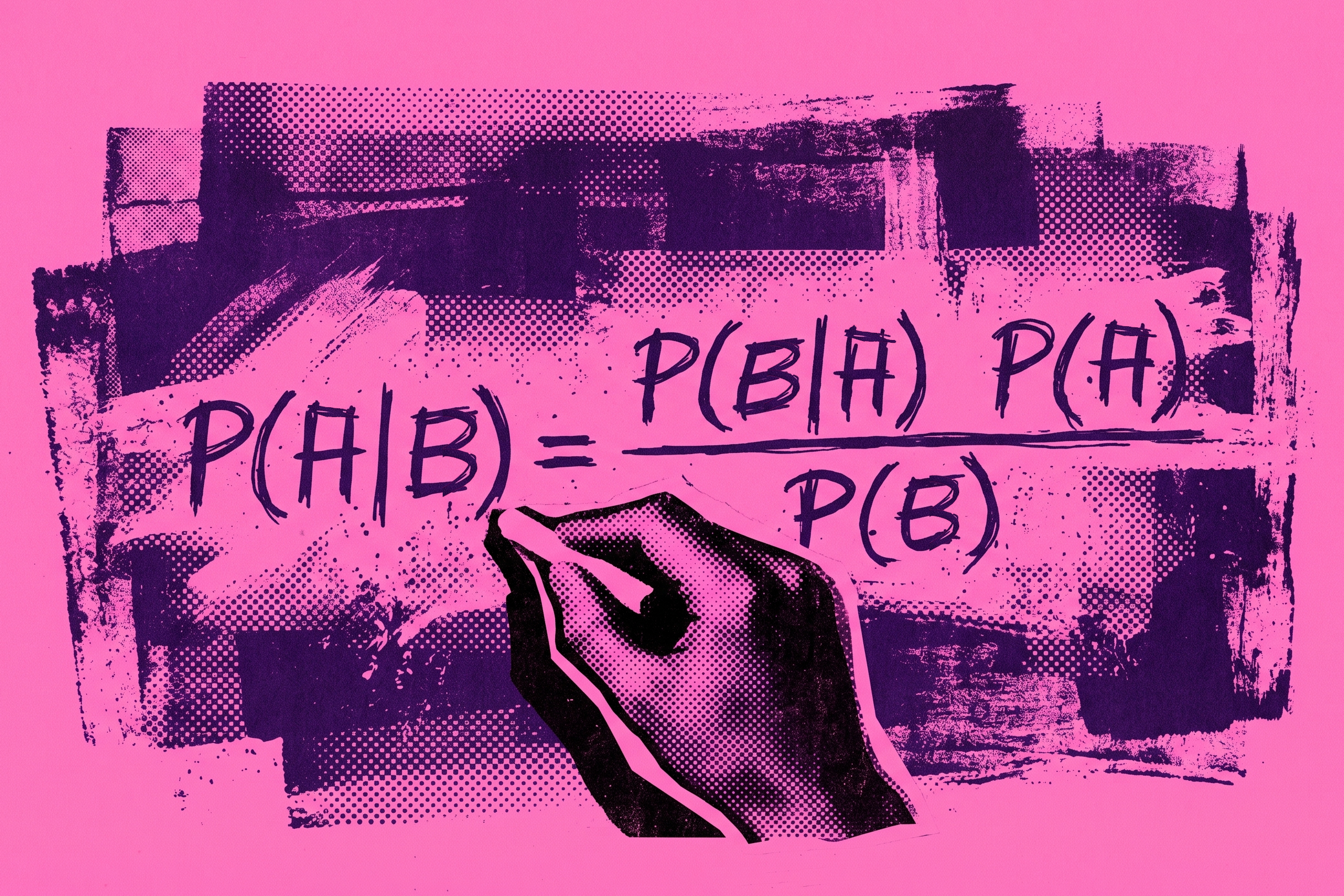

La formule de Bayes

Le cœur du mécanisme tient dans une relation simple :

P(A|B) = [P(B|A) × P(A)] / P(B)

Cette formule peut se lire ainsi : une estimation initiale P(A) est confrontée à une observation B. Cette confrontation produit une nouvelle estimation P(A|B), plus informée. Apprendre, dans ce cadre, consiste donc à se déplacer dans l’espace des probabilités, pas à atteindre immédiatement une certitude.

L’apprentissage devient une réduction progressive de l’incertitude. Mais cette réduction n’est ni automatique, ni neutre, ni garantie.

Le problème du point de départ

Tout commence par une estimation initiale, appelée prior. Ce point de départ est critique. S’il est mal posé, biaisé ou trop éloigné de la réalité, le modèle peut mettre longtemps à corriger sa trajectoire. Dans certains cas, il peut même renforcer une mauvaise interprétation au lieu de la corriger.

L’incertitude n’efface donc pas les biais. Elle peut les révéler, mais aussi les prolonger. Un modèle probabiliste n’est pas automatiquement plus juste. Il devient plus intéressant lorsqu’il rend visibles les conditions de son propre raisonnement.

Deux formes d’incertitude

Les systèmes d’intelligence artificielle rencontrent au moins deux formes d’incertitude :

- L’incertitude aléatoire, liée au bruit naturel des données : capteur imprécis, mesure instable, variabilité impossible à supprimer totalement.

- L’incertitude épistémique, liée à ce que le modèle ignore encore : manque d’exemples, zones peu représentées dans les données, situations inédites.

Il ne faut pas confondre le bruit du monde avec l’ignorance du modèle. Le premier se gère. La seconde peut s’apprendre.

Le cas des grands modèles de langage

Les grands modèles de langage ne sont pas, dans leur fonctionnement courant, des modèles bayésiens au sens strict. Ils reposent principalement sur des réseaux de neurones entraînés à prédire des séquences de mots ou de fragments de mots. Mais ils travaillent néanmoins dans un espace probabiliste : chaque réponse résulte d’une sélection parmi plusieurs possibilités.

Le problème apparaît lorsque cette distribution de probabilités se transforme en phrase affirmative. Le modèle peut produire une réponse fluide, cohérente en surface, mais factuellement fausse. C’est ce que l’on appelle une hallucination.

Dans ce cas, le problème n’est pas seulement l’erreur. Le problème est l’absence d’expression du doute. Une machine probabiliste peut donner l’impression d’une certitude qu’elle ne possède pas réellement.

Thomas Bayes : L'Architecte de l'Incertitude

On peut être frappé par le fait que Thomas Bayes, pasteur et mathématicien du XVIIIe siècle, soit à l’origine d’une pensée aujourd’hui vitale pour l’intelligence artificielle. Ses travaux, présentés à la Royal Society en 1763 par son ami Richard Price après sa mort, ne visaient évidemment pas les machines. Ils posaient une question plus profonde : comment ajuster la probabilité d'une hypothèse à mesure que de nouvelles preuves apparaissent ?

Cette idée, bien que simple en apparence, constitue un socle conceptuel d’une remarquable robustesse. Elle a traversé les siècles, notamment grâce à Pierre-Simon de Laplace qui lui a donné sa rigueur mathématique, car elle formalise un mécanisme universel face à l’inconnu. Ce processus de mise à jour constante est résumé par le célèbre théorème :

C’est en ce sens que Bayes peut être considéré comme le précurseur, non pas d’une technologie, mais d’une véritable philosophie de l’apprentissage. Dans ce paradigme, l’IA ne cherche pas une vérité absolue, mais une estimation de plus en plus fine. L’incertitude n'y est plus un défaut à gommer, mais le moteur même de la connaissance : une matière première que l'algorithme affine, itération après itération, pour transformer le doute en décision.

L’incertitude comme espace créatif

Cette zone d’incertitude n’est pas seulement un problème technique. Elle peut aussi devenir un espace créatif. Dans les systèmes génératifs, on peut moduler la part d’exploration. À faible variabilité, le modèle choisit les options les plus probables. Le résultat est souvent cohérent, mais attendu. À plus forte variabilité, il explore des zones moins probables.

C’est là que peuvent apparaître des associations inattendues, des rapprochements moins convenus, des formes plus singulières. Ce n’est pas une erreur pure. C’est une bifurcation contrôlée.

La science utilise l’incertitude pour converger vers une vérité plus stable. L’usage créatif de l’IA peut utiliser cette même incertitude pour ouvrir des possibles.

Conclusion

L’incertitude n’est pas l’ennemie de l’intelligence artificielle. Elle en est l’un des matériaux. Elle permet de mesurer ce qui manque, d’ajuster ce qui est fragile et parfois de produire ce qui n’était pas prévu.

Apprendre, dans ce cadre, ne consiste pas simplement à savoir. Cela consiste à réviser en permanence ce que l’on pense probable.

Sources

- https://www.frontiersin.org/journals/big-data/articles/10.3389/fdata.2022.934362/full

- https://www.nature.com/articles/s41586-024-07421-0

- https://dl.acm.org/doi/10.1145/3703155

- https://aclanthology.org/2025.naacl-long.158.pdf

- https://www.sciencedirect.com/science/article/pii/S0045782521004102

- https://www2.aueb.gr/users/ion/docs/ceas2006_paper.pdf